Ο καταξιωμένος ακαδημαϊκός καθηγητής Θεόδωρος Χριστάκης, μιλώντας σήμερα στο Μέγαρο Μουσικής Αθηνών, αναφέρθηκε στους κινδύνους της αλόγιστης χρήσης των chatbots και στη νέα εποχή της τεχνητής νοημοσύνης που εισχωρεί ακόμη και στον ευαίσθητο τομέα της υγείας.

Εμπιστεύεστε τυφλά το Chatbot σας; Λέτε τα πάντα στο ChatGPT, στο Gemini, το DeepSeek ή τα άλλα προγράμματα τεχνητής νοημοσύνης; Χμ… Ίσως θα πρέπει να το ξανασκεφτείτε. Τουλάχιστον όσοι παρακολούθησαν τη σημερινή άκρως κατατοπιστική ομιλία του καθηγητή Διεθνούς, Ευρωπαϊκού και Ψηφιακού Δικαίου στο γαλλικό Πανεπιστήμιο Grenoble Alpes όπου κατέχει την έδρα Responsible AI και Διευθυντή του φημισμένου Κέντρου Διεθνούς Ασφάλειας και Ευρωπαϊκών Σπουδών (CESICE), του κ. Θεόδωρου Χριστάκη, έφυγαν προβληματισμένοι για το εάν και κατά πόσο θα πρέπει να είμαστε τόσο διαχυτικοί στις γραπτές ή προφορικές συνομιλίες που έχουμε με τέτοιου είδους προγράμματα Τεχνικής Νοημοσύνης (AI).

Ο καταξιωμένος ακαδημαϊκός, παραχωρώντας διάλεξη στο πλαίσιο του συνεδρίου «Legal Horizons in the age of AI: Risk, Responsibility and Regulation» που πραγματοποιήθηκε στο Μέγαρο Μουσικής Αθηνών και υλοποιήθηκε υπό την αιγίδα του περιοδικού ΔΙΤΕ (Δίκτυο Τεχνολογίας και Επικοινωνίας), παρουσίασε δημοσίως για πρώτη φορά σε παγκόσμια αποκλειστικότητα, τα αποτελέσματα δύο μελετών που αφορούν την επίδραση της νέας γενιάς των chatbots στη ζωή μας. Παράλληλα επιχείρησε να αναδείξει τις βαθύτερες αλλαγές στον τρόπο με τον οποίο οι άνθρωποι αλληλεπιδρούν με την τεχνητή νοημοσύνη, αλλά και στον τρόπο με τον οποίο οι ίδιες οι εταιρείες διαχειρίζονται τα δεδομένα που προκύπτουν από αυτές τις αλληλεπιδράσεις.

«Μην κοινοποιείται τίποτα που δεν θα αισθανόσασταν άνετα να δείτε δημόσια»

Ο ομιλητής ξεκίνησε από μια απλή αλλά κρίσιμη παρατήρηση: εκατομμύρια άνθρωποι χρησιμοποιούν καθημερινά εργαλεία όπως τα chatbots προκειμένου να συνομιλήσουν μαζί τους για εξαιρετικά προσωπικά ζητήματα, από σχέσεις και οικογένεια μέχρι οικονομικά και επαγγελματικά σχέδια. Αυτό που διαφοροποιεί αυτή τη μορφή επικοινωνίας από την ανθρώπινη είναι το γεγονός ότι ο χρήστης αισθάνεται πως δεν κρίνεται· δεν υπάρχει απέναντί του ένας άνθρωπος, αλλά ένα σύστημα, και αυτή η απουσία κοινωνικής κρίσης οδηγεί σε μεγαλύτερη ειλικρίνεια και αποκάλυψη.

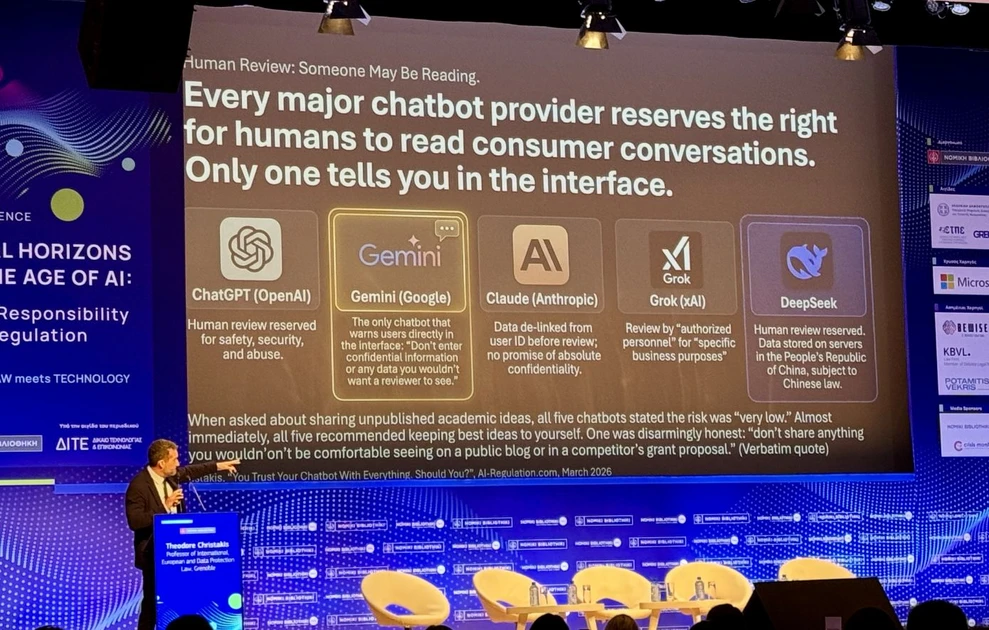

Ωστόσο, αυτή η αίσθηση ασφάλειας είναι σε μεγάλο βαθμό παραπλανητική. Ο κ. Χριστάκης επισημαίνει ότι οι συνομιλίες αυτές δεν είναι απαραίτητα ιδιωτικές – κάτι που το αμελούμε σχεδόν πάντοτε. Μπορεί να χρησιμοποιούνται για λόγους βελτίωσης των συστημάτων, για λόγους ασφαλείας ή για άλλες εσωτερικές λειτουργίες των εταιρειών, ενώ σε ορισμένες περιπτώσεις ενδέχεται να έχουν πρόσβαση σε αυτές ακόμη και άλλοι άνθρωποι.

Από τις πέντε μεγάλες πλατφόρμες τεχνητής νοημοσύνης, ήτοι το ChatGPT (OpenAI), το Gemini (Google), το Claude (Anthropic), το Grok (xAI) και το κινεζικό DeepSeek, μονάχα η μια (το Gemini) αναφέρει ξεκάθαρα ότι διατηρεί το δικαίωμα να διαβάσουν υπό προϋποθέσεις άνθρωποι (ενδεχομένως της εταιρείας ή των Αρχών ασφαλείας) τους διαλόγους που έχουμε με το AI. Καλό θα ήταν λοιπόν να μην μοιραζόμαστε πληροφορίες που θα μπορούσε να δει και κάποιος τρίτος. «Το γεγονός ότι αυτό το δικαίωμα να μπορεί και κάποιος άλλος να έχει πρόσβαση στους διαλόγους μας, δείχνει ότι το πρόβλημα δεν είναι θεωρητικό, αλλά ουσιαστικό και παρόν» σημειώνει ο καθηγητής.

Όταν ρωτήθηκαν οι πλατφόρμες τεχνητής νοημοσύνης στους διαλόγους με τους χρήστες για το εάν είναι ασφαλές να κοινοποιήσει κάποιος σε αυτές μια ακαδημαϊκή αδημοσίευτη ιδέα και οι πέντε απάντησαν ότι ο κίνδυνος διαρροής είναι χαμηλός. Σχεδόν αμέσως όμως, όλες μα όλες συνέστησαν «να κρατήσετε τις καλύτερες ιδέες για τον εαυτό σας», ενώ μια από αυτές ήταν αφοπλιστικά ειλικρινής απαντώντας ότι «δεν θα πρέπει να κοινοποιείται τίποτα που δεν θα σας ήταν άνετο να το δείτε σε ένα δημόσιο ιστολόγιο ή σε μια πρόταση ανταγωνιστή σας» (αυτολεξεί στα αγγλικά δόθηκε η συγκεκριμένη απάντηση).

Οι διαφημίσεις έχουν εισέλθει στο chat

Ο ακαδημαϊκός καθηγητής έκανε επίσης ειδική μνεία στο οικονομικό υπόβαθρο αυτών των τεχνολογιών. Τόνιζε πως δεν υπάρχει «δωρεάν» χρήση: το γεγονός ότι η πλειονότητα των χρηστών χρησιμοποιεί εκδόσεις για τις οποίες δεν δίνει ούτε ένα ευρώ, σημαίνει ότι οι εταιρείες αναζητούν άλλους τρόπους χρηματοδότησης για την παροχή της συγκεκριμένης υπηρεσίας. Το κόστος ανάπτυξης και λειτουργίας των AI συστημάτων είναι τεράστιο και οι συνδρομές δεν επαρκούν για να το καλύψουν. Έτσι, οι εταιρείες οδηγούνται αναπόφευκτα σε μοντέλα που θυμίζουν τις άλλες μεγάλες ψηφιακές πλατφόρμες, όπως είναι τα social media και οι μηχανές αναζήτησης: αξιοποίηση των δεδομένων και εμβόλιμες διαφημίσεις.

Σε αυτό το σημείο λοιπόν εισάγεται μια από τις πιο ανησυχητικές διαστάσεις, η ενσωμάτωση διαφημίσεων μέσα στις ίδιες τις συνομιλίες. Ο ομιλητής περιέγραψε σενάρια όπου μια φαινομενικά ουδέτερη συζήτηση μπορεί να μετατραπεί σε εμπορική ευκαιρία, με προτάσεις προϊόντων ή υπηρεσιών να εμφανίζονται ως μέρος της «βοήθειας». Το πρόβλημα εδώ δεν είναι μόνο η ύπαρξη διαφήμισης, αλλά το γεγονός ότι αυτή ενσωματώνεται σε ένα περιβάλλον υποτιθέμενης εμπιστευτικότητας των όσων λέγονται, όπου ο χρήστης είναι πιο ευάλωτος και πιο δεκτικός σε επιρροή. Ακόμη κι αν σήμερα υπάρχει μια σειρά από περιορισμούς (για παράδειγμα σε θέματα υγείας) τίθεται το ερώτημα εάν και κατά πόσο αυτοί οι περιορισμοί θα διατηρηθούν και στο μέλλον, υπό την πίεση για αύξηση των εσόδων.

Για την ιστορία το OpenAI ήταν το πρώτο που ξεκίνησε να δοκιμάζει να βάζει διαφημίσεις στο ChatGPT, και ειδικότερα στις δωρεάν εκδόσεις της πλατφόρμας και μόνο για ενήλικους χρήστες των Ηνωμένων Πολιτειών.

Δομούν το προφίλ του χρήστη

Κεντρικό ρόλο σε όλη αυτή τη συζήτηση παίζει όμως και η έννοια της «μνήμης» των AI συστημάτων. Σε αντίθεση με μια απλή αναζήτηση στο Διαδίκτυο, όπου κάθε ερώτημα είναι σχετικά απομονωμένο, τα σύγχρονα AI μπορούν να θυμούνται και να συνδέουν πληροφορίες από πολλές συνομιλίες. Αυτό σημαίνει ότι σταδιακά δομείται ένα εξαιρετικά λεπτομερές προφίλ του χρήστη, που περιλαμβάνει όχι μόνο προτιμήσεις αλλά και σημαντικά προσωπικά στοιχεία. Ο κ. Χριστάκης τονίζει ότι πρόκειται για ένα επίπεδο προσωποποίησης τόσο υψηλό, που δεν το είχαμε συναντήσει ποτέ ξανά έως σήμερα, και αυτό ακριβώς το καθιστά τόσο ισχυρό αλλά και συνάμα επικίνδυνο.

Το AI γίνεται ο προσωπικός μας γιατρός

Ένα σημαντικό μέρος της διάρκειας 45 λεπτών ομιλίας του στο Μέγαρο Μουσικής Αθηνών, ο καθηγητής Διεθνούς, Ευρωπαϊκού και Ψηφιακού Δικαίου στο Grenoble Alpes το αφιέρωσε στη διαδικτυακή αναζήτηση που κάνουμε για θέματα υγείας. Όλο και περισσότεροι αναζητούν στις μέρες μας απαντήσεις για ασθένειες ή για το πώς θα βελτιώσουν τη φυσική και σωματική τους κατάσταση. Από απλές ερωτήσεις όπως τι σημαίνουν τα αποτελέσματα των εξετάσεων ή γιατί εμφανίζεται ένας πόνος σε ένα συγκεκριμένο σημείο, μέχρι ανησυχίες για παρενέργειες φαρμάκων σε κοντινά τους πρόσωπα. Σύμφωνα με στοιχεία της OpenAI, κάθε εβδομάδα πάνω από… 230 εκατομμύρια χρήστες παγκοσμίως απευθύνονται σε chatbots για θέματα υγείας και ευεξίας, γεγονός που δείχνει ότι η ψηφιακή συμβουλή έχει γίνει μέρος της καθημερινότητάς μας.

Αυτό το φαινόμενο δεν πέρασε απαρατήρητο από τις μεγάλες τεχνολογικές εταιρείες κατά τον κ. Χριστάκη. Σε διάστημα μόλις τριών μηνών, η OpenAI, η Anthropic, η Microsoft, η Amazon και η Perplexity παρουσίασαν νέες υπηρεσίες τεχνητής νοημοσύνης ειδικά για την υγεία. Αντί για απλές γενικές συμβουλές τύπου «πάρε νερό και συμβουλέψου τον γιατρό», αυτά τα συστήματα προσπαθούν να γίνουν πλέον οι προσωπικοί μας ψηφιακοί βοηθοί, συλλέγοντας και ερμηνεύοντας δεδομένα που μέχρι σήμερα ήταν διασκορπισμένα σε γιατρούς, νοσοκομεία και εφαρμογές ευεξίας.

Στην πρώτη συγκριτική μελέτη για αυτή τη νέα αγορά που δημοσιεύεται από τον καταξιωμένο ακαδημαϊκό υπογραμμίζεται πως οι συνομιλίες χρηστών με την τεχνητή νοημοσύνη για θέματα υγείας δεν μπορούν να αντιμετωπίζονται με τον ίδιο τρόπο όπως οι απλές καθημερινές συνομιλίες.

Ο κίνδυνος του να εμπιστευτείς όλο τον ιατρικό σου φάκελο στο AI

Θα πρέπει κάποιος να παρέχει σε ένα chatbot ολόκληρο τον ιατρικό του φάκελο; Τα οφέλη μπορεί να είναι σημαντικά, καθώς ένα AI που γνωρίζει το ιστορικό, τις εξετάσεις και τα δεδομένα από wearables μπορεί να προσφέρει εξατομικευμένες, ασφαλείς συμβουλές. Η απουσία τέτοιων πληροφοριών μπορεί να καταστήσει τις γενικές συστάσεις όχι μόνο ανακριβείς αλλά και επικίνδυνες.

Η μελέτη του Χριστάκη εγείρει ωστόσο πέντε κρίσιμα ζητήματα:

Το πρώτο αφορά τον τρόπο αξιοποίησης των δεδομένων. Οι εταιρείες διαβεβαιώνουν ότι τα στοιχεία υγείας δεν χρησιμοποιούνται για την εκπαίδευση των βασικών μοντέλων τεχνητής νοημοσύνης, ωστόσο αυτή η δέσμευση δεν σημαίνει ότι τα δεδομένα μένουν ανενεργά. Μπορούν να αξιοποιηθούν για εσωτερικές αναλύσεις, βελτίωση υπηρεσιών ή εντοπισμό προτύπων συμπεριφοράς.

Το δεύτερο ζήτημα σχετίζεται με τη συγκέντρωση δεδομένων σε λίγες πλατφόρμες. Αν μεγάλος αριθμός πολιτών αρχίσει να ενσωματώνει σε αυτές τα ιατρικά του αρχεία, τις φαρμακευτικές αγωγές, τα δεδομένα από wearables και τις συνομιλίες του, θα δημιουργηθούν τεράστια ιδιωτικά αποθετήρια πληροφοριών υγείας. Η αξία αυτών των δεδομένων είναι πολυδιάστατη, καθώς μπορεί να αξιοποιηθεί τόσο για εμπορικές υπηρεσίες όσο και για επιστημονική έρευνα ή πρόβλεψη υγειονομικών τάσεων. Το κρίσιμο ερώτημα που ανακύπτει είναι ποιος θα έχει τον έλεγχο αυτής της γνώσης και ποιος θα καθορίζει τους όρους πρόσβασης σε αυτήν.

Το τρίτο σημείο αφορά τη θέση της Ευρώπης. Ενώ η Ευρωπαϊκή Ένωση προχωρά με αυστηρούς κανόνες στη δημιουργία του Ευρωπαϊκού Χώρου Δεδομένων Υγείας, οι ιδιωτικές πλατφόρμες μπορούν να κινηθούν ταχύτερα, συγκεντρώνοντας δεδομένα απευθείας από τους χρήστες. Δημιουργείται έτσι μια εμφανής ανισορροπία: από τη μία πλευρά ένα θεσμικά ελεγχόμενο αλλά πιο αργό σύστημα και από την άλλη ιδιωτικοί φορείς που μπορούν να εξελιχθούν πολύ πιο γρήγορα, χωρίς τα ίδια επίπεδα εποπτείας.

Το τέταρτο ζήτημα αφορά τον κίνδυνο παραβιάσεων ασφαλείας. Σε περίπτωση κυβερνοεπίθεσης, οι συνέπειες δεν θα περιορίζονταν σε μια απλή διαρροή δεδομένων. Θα μπορούσαν να αποκαλυφθούν ταυτόχρονα ευαίσθητες ιατρικές πληροφορίες, προσωπικές συνήθειες και ιστορικά συνομιλιών εκατομμυρίων χρηστών, δημιουργώντας ένα πρωτοφανές περιστατικό σε παγκόσμια κλίμακα.

Το πέμπτο και τελευταίο ζήτημα σχετίζεται με το επιχειρηματικό μοντέλο αυτών των υπηρεσιών. Παρότι συχνά εμφανίζονται ως δωρεάν ή χαμηλού κόστους, ενσωματώνονται σε ευρύτερα οικοσυστήματα υπηρεσιών. Όσο περισσότερα δεδομένα συγκεντρώνει ένας χρήστης σε μία πλατφόρμα, τόσο δυσκολότερη γίνεται η αποχώρησή του από αυτήν. Αυτό σημαίνει ότι η πραγματική δοκιμασία δεν είναι οι σημερινές υποσχέσεις προστασίας, αλλά το αν αυτές θα διατηρηθούν όταν οι υπηρεσίες περάσουν σε φάση πλήρους εμπορικής αξιοποίησης.

Μέσα σε αυτό το πλαίσιο, προτείνεται η ανάγκη για τη δημιουργία «ασφαλών ζωνών» χρήσης της τεχνητής νοημοσύνης, ειδικά για ευαίσθητα θέματα όπως η υγεία ή τα νομικά ζητήματα. Σε αυτές τις ζώνες, θα πρέπει να ισχύουν αυστηροί κανόνες: να μην χρησιμοποιούνται τα δεδομένα για εκπαίδευση ή διαφήμιση, να μην διατηρείται μνήμη, να υπάρχει ισχυρή κρυπτογράφηση και αυστηρός έλεγχος πρόσβασης. Η λογική είναι ότι ο χρήστης πρέπει να μπορεί να μιλήσει με την ίδια ασφάλεια που θα είχε σε ένα προστατευμένο ανθρώπινο περιβάλλον.

Η μάχη για τα δεδομένα

Παράλληλα, ο ομιλητής επεσήμανε ότι η «μάχη για τα δεδομένα» έχει ήδη ξεκινήσει, χωρίς να το έχει συνειδητοποιήσει η πλειονότητα των πολιτών. Οι μεγάλες εταιρείες ανταγωνίζονται για την πρόσβαση και την αξιοποίηση αυτών των δεδομένων, ενώ τα κράτη και οι ρυθμιστικές αρχές, ιδιαίτερα στην Ευρώπη, φαίνεται να κινούνται πιο αργά από τις τεχνολογικές εξελίξεις.

Συμπερασματικά ο κ. Θεόδωρος Χριστάκης σημειώνει πως το AI δεν είναι απλώς ένα τεχνολογικό εργαλείο, αλλά μια δύναμη που αναδιαμορφώνει την οικονομία, την κοινωνία και την έννοια της ιδιωτικότητας. Οι δυνατότητές της είναι τεράστιες, αλλά το ίδιο ισχύει και για τους κινδύνους. Το κρίσιμο ζήτημα δεν είναι αν η AI θα χρησιμοποιηθεί ακόμη εντονότερα στο μέλλον, αυτό είναι δεδομένο, αλλά με ποιους όρους, ποιος θα έχει τον έλεγχο των δεδομένων και αν οι χρήστες θα προστατευθούν επαρκώς σε αυτή τη νέα πραγματικότητα.